有一个职业,每天从上班到下班就是看一些淫秽、强奸、自杀、砍头的照片或视频,根据内容快速做出决策,主管还会时不时催促加快进度。这样的工作,给多少钱你愿意做呢?一个美国女子“受够了”这项工作的摧残,近日把雇主告上法庭。

上班造成“内伤”

愤而起诉脸书

“鉴黄师”这个名头,只是人们对这个职业的调侃性称呼。实际上,他们审核的不仅是“黄”,还包括其他一切不合规定的内容。在美国,这个职业通常被称作“内容审查员”。

社交媒体巨头脸书在全球拥有超过7500名内容审查员,每周要审核超过1000万个有问题的帖子。这样的工作通常通过外包完成,赛琳娜·斯科拉就是其中一员。她受雇于一家名为“专业无限”的公司,从2017年6月起为脸书工作。短短9个月后,她的健康状况亮起了红灯。

在起诉书中,斯科拉的律师表示,在审看了成千上万个血腥暴力的图片和视频后,“由于持续高强度地处于这样的工作环境中”,斯科拉受到严重的心理创伤,并出现“创伤后应激障碍综合征(PTSD)”。具体表现为当她触碰鼠标、走进冷气比较足的大楼、在电视上看到暴力画面、听到较大声响或受到惊吓时,就会感到极度不适。

对这起诉讼,脸书回应称,从入职培训、员工福利到心理关怀,公司高度重视对内容审查员的支持。

这已不是科技公司首次遭遇类似诉讼。2017年两名微软员工也声称,“工作时需审查极度令人不适的内容”令他们患上PTSD,因而把微软告上法庭。另一起诉讼的原告内容审查员表示,他每天早上9时开始上班,打开电脑看到的就是某人被砍头的画面,“每天、每分钟看到的都是这些”。

随着近年来互联网公司加大对内容审查的投入,内容审查员的工作保障、福利待遇、心理创伤医治等问题越来越受到各界重视。

工作内容恶心

企业福利没份

按照 “钱多、事少、离家近”的好工作标准来衡量,内容审查员这份工作着实不怎么样。起诉脸书的斯科拉工资有多少,诉状和媒体都没有披露。不过2017年《华尔街日报》曾采访过另一名内容审查员凯兹,她的每小时薪水是24美元。这基本上相当于美国平均水平,不过远低于加州,尤其是硅谷地区。

在美国求职网站Indeed上搜索“内容审查员”就会发现,绝大多数招工启事列明的薪水在5.5万美元这一档以下,以4万美元为最多。相比之下,美国家庭年收入中位数是5.76万美元,硅谷所在地帕洛阿图市的家庭年收入中位数是13.7万美元,脸书员工的年收入中位数更是高达24万美元。

内容审查员每天要审核大量内容,通常需要在很短时间内就决定一个帖子或用户是否违反政策需要封禁。以凯兹为例,她通常需要在10秒内对问题帖子做出“生杀决断”。如果工作完成数量不达标,员工将收到警告,通常三次警告就意味着必须走人。凯兹在工作期间看了大量儿童色情视频,这让她感到恶心,更不用提像斯科拉这样的员工留下了深重的心理创伤。

这项工作为数不多的好处之一,是像凯兹这样要到雇主脸书总部上班的内容审查员,可以享受那里不错的免费员工午餐和无限供应的零食饮料。另外一些雇员尤其是兼职者,则可以享受在家工作的便利。但他们中绝大多数都是受雇于第三方外包公司,而不是脸书这样真正需要进行内容审查的企业的正式员工,这就意味着他们无法享受这些顶级企业的福利和医疗待遇。

据《商业内幕》网站报道,凯兹和其他内容审查员在为脸书等大企业工作之前都要签署一份免责协议书,其中说明他们自愿审核这些“可能会对某些人构成冒犯”的内容。这样做是为了避免让企业陷入法律诉讼,也使企业不必为员工的心理健康投入太多。

怪不得《华尔街日报》将内容审查员称作美国科技业“最差工作”。

如何加强审查

社媒头疼不已

另一方面,大型科技公司也有自己的苦衷。在美国,互联网服务商应不应该对平台上的内容进行审查、对哪些内容进行审查一直存在争议。就拿涉黄内容来说,除了儿童色情被明令禁止以外,一般的色情内容是否可以在网上传播,法律的界定比较模糊。

另外,像“9·11恐怖袭击是美国政府自导自演的”“康涅狄格州桑迪胡克小学枪击案并没有发生过”等阴谋论,也明显违反社会共识和人类良知,甚至给当事人造成困扰。曾经有枪击案受害者的家属受到相信阴谋论的人跟踪和骚扰,被指责为“是在演戏”。

这些文字、图片、视频大多数受到美国宪法第一修正案也就是言论自由权的保护,美国政府无权要求不得发表。不过,像谷歌、脸书、推特这样的网络平台,作为私人企业却有权为用户制定规则,并删除不符合规则的内容,甚至封禁相应账户。然而,这些规则如何制定,哪些内容需要删除,完全取决于各个平台自身,这有时候会导致某些内容在一个平台上被封禁,在另一个平台上则被允许存在。

最近的例子是,美国著名极右翼阴谋论者、“信息战争”网站创始人阿莱克斯·琼斯的脸书账号、优兔账号和苹果商店的广播订阅账号因屡次违规,在8月6日这一天分别遭到永久封禁和删除。不过,他在推特上的账号安然无恙。推特官方当天发表声明称,琼斯的推特账号并未违反该平台规定。不过,一个月之后的9月7日,推特迫于压力也永久删除了琼斯的账号。

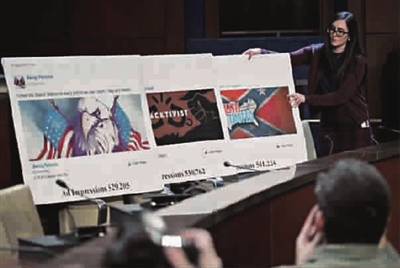

近年来,一方面网络内容日益丰富、以用户为主体发布的内容呈爆炸性增长;另一方面国际上恐怖主义盛行、美国国内社会分裂日益加剧、极端言论层出不穷,这些都给内容审核增加了不小的难度。同时美国政府和社会越来越强调社交媒体的社会属性,使它们无法再以言论自由为借口,对一些“出格”内容不作处理放任传播。尤其是2016年美国大选后,关于俄罗斯干预大选的指控愈演愈烈,仅脸书上就充斥着各方势力或真或假的选举消息,拉拢、迷惑、诱导选民,加强内容审核势在必行。

在斯科拉开始为脸书服务前的一个月,也就是2017年5月,脸书首席执行官扎克伯格承认,“暴力内容”是公司面临的一个问题,并宣布将再次增加3000名内容审查员。而在此之前,脸书等社交媒体已经多次扩充这方面的力量。

短时间内大量扩军,再加上科技巨头们不愿意给内容审查员以“正规军”身份,导致这个行业成为科技业员工满意度最低、离职率最高的行业之一,出现像斯科拉这样员工提起的诉讼也就不足为奇。

相关链接

审查效率低下

脸书受到质疑

2017年4月24日,一名泰国男子在脸书上直播勒死自己的女儿,随后上吊自杀。脸书时隔24小时才撤下视频,内容审查效率受到质疑。

该男子名叫汪太莱,年龄为21岁。他将自己11个月大的女儿带到普吉岛上一个废弃的旅馆中,用智能手机拍摄他用一条绳索绕上女儿的脖子并从屋顶将她扔下的过程。视频被上传到脸书上,45分钟后汪太莱的妻子特里拉塔娜看到视频立刻报案。泰国警方赶到案发地时,发现汪太莱已经在女儿的尸体旁上吊自杀。

记录汪太莱杀死女儿全部过程的两段视频分别在24日16时50分和16时57分通过脸书的直播功能上传,直到25日17时才被脸书移除。此时第一段视频点击量为11.2万次,第二段视频为25.8万次。

与此同时该视频也被上传到视频网站优兔上,15分钟内就被移除,点击量为2351次。

英国下议院文化委员会议员表示:“这是又一个体现脸书缺乏监督的例子,令人作呕的画面被大规模传播和分享。”

期待人工智能

接手内容审查

既然内容审查员工作枯燥又难受, 是否能借助人工智能来完成呢?问题在于,在人类尚且不能达成共识的问题上,又怎么能放手交给机器去判断?

1964年,美国最高法院大法官斯图尔特在一项判决中说:“我不会试图给‘淫秽’下一个准确的定义,但当我看到(争议内容)时,我就知道(它是否应该受到言论自由的保护)。”

这一被后人总结为“当我看到我就知道”的著名论述在今天仍然有意义。就拿色情内容来说,人们在界定一些内容究竟是艺术、自由表达还是淫秽时,由于标准通常是主观的,所以有时候仍然存在分歧。

尽管人工智能已经取得了长足进步,在一些领域可以较好地完成甄别任务,但更多的时候,人眼仍然不可或缺。或许在未来,有着强大学习能力的人工智能最终能完全接手,把人类内容审查员解放出来。